Nano Banana

Kurzfassung

▾

Quellen

▾

Die Forscher Hu, Rostami und Thomason belegen, dass Experten-Prompts die Genauigkeit von KI-Modellen bei Faktenfragen stark verschlechtern.

Das reine Rollenspiel zwingt die Systeme in ein Muster und blockiert so das vortrainierte Wissen.

Anwender sollten für logische Aufgaben komplett auf Rollen wie „Experte“ oder „Lehrer“ verzichten.

Mit PRISM präsentieren die Autoren ein neues Framework, das die Persona über einen LoRA-Adapter nur bei passenden generativen Aufgaben aktiviert.

arXiv: Expert Personas Improve LLM Alignment but Damage Accuracy: Bootstrapping Intent-Based Persona Routing with PRISM

arXiv: PDF Document (2603.18507)

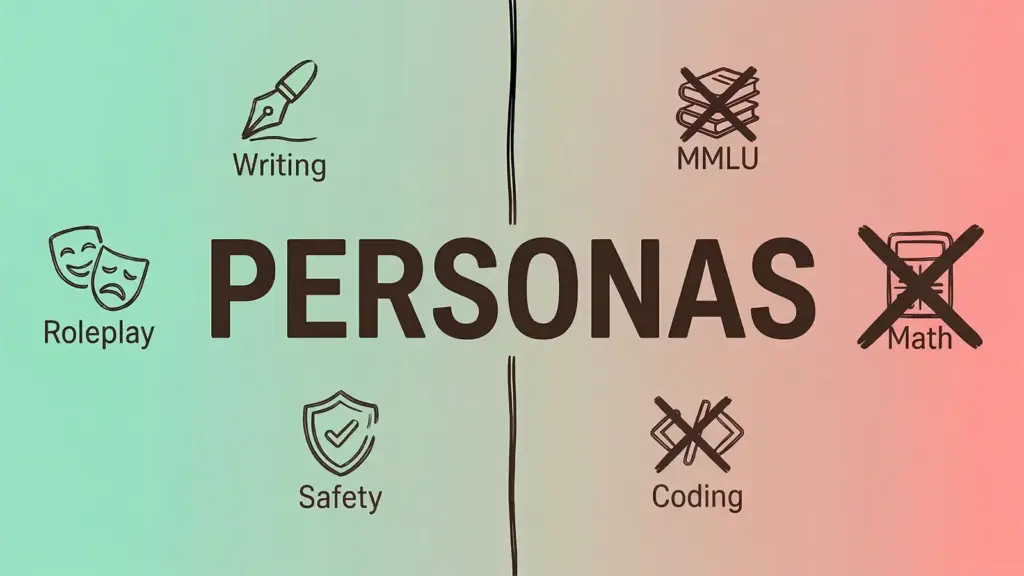

Nutzer geben KI-Modellen oft eine konkrete Rolle vor, um bessere Antworten zu erhalten. Eine detaillierte Untersuchung zeigt nun: Dieses Vorgehen macht die Antworten zwar stilistisch ansprechender und filtert schädliche Anfragen besser heraus, blockiert aber gleichzeitig das logische Denken und die Faktenstärke der Modelle. Die Köpfe und der Umfang der Untersuchung Die Forscher Zizhao Hu, Mohammad Rostami und Jesse Thomason haben die gängige Prompting-Praxis detailliert analysiert. Sie testeten das Verhalten über verschiedene KI-Modelle hinweg. Dabei berücksichtigte das Team sowohl klassische als auch auf komplexes Reasoning spezialisierte Modelle. Die Studie umfasste zudem die Länge der Eingaben sowie die exakte Platzierung der Anweisungen im Prompt. Die Wissenschaftler stellten fest, dass die Effektivität einer zugewiesenen Rolle extrem von der jeweiligen Aufgabe abhängt. Anzeige Der Konflikt zwischen Stil und Fakten Ein pauschaler Faktor für den exakten Leistungsverlust lässt sich aus der Untersuchung nicht ableiten, da die Ergebnisse je nach Modellarchitektur variieren. Die Autoren belegen jedoch einen signifikanten und durchgehenden Absturz der Genauigkeit bei standardisierten Wissenstests. Dieser negative Effekt tritt besonders deutlich beim bekannten MMLU-Benchmark zutage. Die KI-Modelle konzentrieren sich durch die zugewiesene Rolle zu stark auf menschliche Präferenzen und den passenden Tonfall. Dadurch rückt der eigentliche Abruf des Faktenwissens komplett in den Hintergrund. Die strenge Vorgabe zwingt das Modell in ein enges Verhaltensmuster. Anstatt das gesamte vortrainierte Wissen abzurufen, verliert sich die künstliche Intelligenz im reinen Rollenspiel. + Quelle: https://arxiv.org/pdf/2603.18507 Das PRISM-Framework als technischer Ausweg Als technische Antwort auf dieses Problem entwickelten die Wissenschaftler das Framework PRISM. Die Abkürzung steht für Persona Routing via Intent-based Self-Modeling. Diese Architektur analysiert die zugrundeliegende Absicht eines Nutzers vor der eigentlichen Textgenerierung. Ein dynamischer LoRA-Adapter schaltet die Experten-Eigenschaften anschließend nur bei passenden Anfragen zielgerichtet hinzu. Der gesamte Prozess kommt dabei völlig ohne externe Daten aus. Durch dieses intelligente Routing und ein effizientes Fine-Tuning bewahren die Modelle ihre volle Genauigkeit bei reinen Wissensabfragen. Gleichzeitig wenden sie die schützende Persona weiterhin erfolgreich bei generativen Aufgaben an. + Quelle: https://arxiv.org/pdf/2603.18507 Klare Trennlinie für den Alltag Die Untersuchung zieht eine deutliche Grenze zwischen verschiedenen Anwendungsbereichen. Wenn Nutzer kreative Texte verfassen, ein Rollenspiel simulieren oder Wert auf inhaltliche Vorsicht legen, verbessert die Expertenrolle das Ergebnis deutlich. Bei Aufgaben, die auf erlerntem Grundwissen basieren, schadet der Ansatz hingegen erheblich. Dazu zählen Mathematik, Programmierung oder standardisierte Wissenstests. Sobald Anwender harte Fakten oder tiefes Reasoning benötigen, sollten sie daher strikt auf eine Rollenzuweisung verzichten. Es hilft dabei auch nicht, den strikten Begriff des Experten durch weichere Alternativen wie einen Lehrer zu ersetzen. Die KI-Modelle benötigen für logische Antworten einen völlig neutralen und direkten Prompt. Anzeige Technische Grenzen der Untersuchung Die Studie weist derzeit noch einige technische Einschränkungen auf. Die Forscher testeten ihr PRISM-Framework bisher ausschließlich an kleineren KI-Modellen mit sieben bis acht Milliarden Parametern. Ob die Leistungssteigerung bei deutlich größeren Modellen im gleichen Maßstab eintritt, bleibt noch offen. Zudem lässt sich die Architektur durch ihren speziellen Mechanismus nicht ohne Weiteres mit anderen LoRA-Erweiterungen kombinieren. Die feste Koppelung erschwert die Integration in bestehende Abläufe. Auch bei Modellen, die bereits extrem auf ein enges Fachgebiet spezialisiert sind, sinkt der zusätzliche Nutzen. Die Forscher weisen darauf hin, dass bei stark angepassten KI-Modellen schlichtweg weniger Raum für eine stilistische Verbesserung durch dynamische Rollen bleibt.

Quelle: www.all-ai.de